Sorulara cevap vermek, istendiğinde metin, hatta kod oluşturmak AI kullanan sohbet robotu ChatGPT, Kasım 2022’de ortaya çıkmasından bu yana, tarihteki en süratli büyüyen internet uygulaması oldu. Yalnızca iki ay içinde 100 milyon faal kullanıcıya ulaştı.

Teknoloji müşahede şirketi Sensor Town’a nazaran, Instagram’ın bu kullanıcı sayısına ulaşması 2,5 yıl sürmüştü.

ChatGPT’nin ortaya çıkmasıyla birlikte, AI güvenliğiyle ilgili ateşli bir tartışma başladı.

Microsoft’un mali dayanağıyla Open AI şirketi tarafından geliştirilen ChatGPT, yapay zekânın insanlığın geleceğine tesirleri konusunda ağır bir spekülasyon başlattı.

AI Güvenliği Merkezi’nin internet siteside yayımlanan ve “AI’den kaynaklanan yok olma riskini azaltmak, pandemiler ve nükleer savaş üzere büyük risklerle birlikte, global bir öncelik olmalı” açıklamasına onlarca uzman dayanak verdi.

Ama birtakım uzmanlar da, endişelerin abartıldığını söylüyor.

İnsanları taklit etmek

ChatGPT, DALL-E, Bard ve AlphaCode üzere yapay zekâ uygulamalarının ürettiği, denemeler, şiirler, espriler, bilgisayar kodları, metinler, diyagramlar, fotoğraflar, sanat yapıtları insan eliyle yapılanlardan farksız olabiliyor.

Bu uygulamaları öğrenciler ödevlerini yapmak, siyasetçiler konuşma metinlerini yazmak için kullanıyor. Bu siyasetçilerden sonuncusu, Demokrat Parti’den ABD Temsilciler Meclisi Üyesi Jake Auchincloss oldu.

Teknoloji devi IBM, AI tarafından yapılabilecek işlerde vazifeli 7 bin 800 kişinin yerine eleman alınmayacağını duyurdu.

AI ilerledikçe, insanların yaptığı işleri devralma kabiliyeti de artıyor.

Tüm bu değişiklikler size fazla geldiyse, kendinizi şunlara hazırlayın:

AI’nin yalnızca birinci basamağındayız ve kimi bilim insanlarının insanoğlunun varlığını tehdit edebileceğinden korktuğu iki etap daha yolda.

İşte AI’nin üç evresi.

1. Dar Yapay zekâ (ANI)

Dar IA olarak da bilinen Dar Yapay zekâ (ANI), tek bir vazifeye odaklanıyor ve belli misyonları yerine getiriyor.

Genelde internetten çok fazla data öğreniyor, lakin yalnızca programlandığı muhakkak bir alanda.

Buna bir örnek satranç programları. Dünya şampiyonunu yenebiliyorlar ancak öteki bir vazife yerine getiremiyorlar.

Dar Yapay zekâ, insanları yenebiliyor fakat yalnızca muhakkak bir alanda.

Akıllı telefonlar bu teknolojiyi kullanan uygulamalarla dolu. GPS haritalarından, sizin üslubunuzu bilen ve tavsiyelerde bulunan müzik ve görüntü programlarına kadar.

Sürücüsüz araçlar ve ChatGPT üzere daha karmaşık sistemler de Dar Yapay zekâ’nın farklı formları. Belirlenmiş bir dizi rolün dışında faaliyet gösteremiyorlar, yani kendi kendilerine karar alamıyorlar.

Ancak birtakım uzmanlar, ChatGPT ve AutoGPT üzere otomatikman öğrenmeye programlı sistemlerin bir sonraki gelişme basamağına geçebileceğine inanıyor.

2. Yapay Genel zekâ (AGI)

Yapay Genel zekâ’ya, bir makinenin bir insanın yapabileceği her entellektüel misyonu yerine getirmesiyle ulaşılacak.

Yapay Genel zekâ, bir makinenin bir beşerle birebir entellektüel kapasiteye sahip olduğu nokta.

‘6 ay orta verilsin’ çağrısı

Mart 2023’te, 1000’den fazla teknoloji uzmanı, “tüm AI laboratuvarlarına, ChatGPT’nin en son versiyonu GPT- 4’ten güçlü tüm sistemlerde AI’nin eğitimine derhal 6 ay orta verilmesi” daveti yaptı.

Apple’ın kurucularından Steve Wozniak, Tesla ve Space X’in sahibi Elon Musk’ın a ortalarında bulunduğu öbür teknoloji uzmanları, “İnsanlarla rekabet edebilecek AI sistemleri, topluma ve insanlığa karşı çok büyük riskler oluşturuyor” diye yazdı.

Elon Musk, firmanın önder takımıyla sorun yaşayıp, istifa etmesinden evvel Open AI’ın kurucularından biriydi.

Kâr maksadı gütmeyen kuruluş Hayatın Geleceği Enstitüsü tarafından yayımlanan mektupta uzmanlar, “şirketler projelerini hemencecik durdurmazsa, hükümetlerin devreye girmesini ve bir moratoryum ilan etmesi gerektiğini”, böylelikle güvenlik tedbirlerinin tasarlanıp, uygulanabileceğini söyledi.

‘Zeki olduğu kadar aptal da’

Oxford Üniversitesi’ndeki AI’de Etik Enstitüsü’nen Carissa Veliz de bu mektupa imza attı. Lakin daha sonra AI Güvenliği Merkezi’nin insanlığın yok olmasından kelam eden açıklamasının çok ileri gittiğini ve bu yüzden imzalamamaya karar verdiğini belirtti.

Carissa Veliz BBC’ye yaptığı açıklamada “Şu anda inşa ettiğimiz AI tipi zeki olduğu kadar aptal da. ChatGPT ya da başkalarını deneyenler, çok çok değerli eksikleri olduğunu görecektir” dedi.

Veliz ayrıyeten AI’nin dev oranlarda dezenformasyon üretebileceğinden tasa duyduğunu belirtti ve “2024’teki Amerikan başkanlık seçimleri yaklaşırke ve Twitter ve başkaları AI etiği ve güvenlik gruplarını işten atarken, ben bundan daha çok kaygılıyım” diye konuştu.

ABD idaresi potansiyel tehditleri kabul ediyor.

Beyaz Saray’dan 4 Mayıs’ta yapılan yazılı açıklamada “AI günümüzün en güçlü teknolojisi, lakin sunduğu fırsatları kullanmak için, öncelikle risklerini azaltmalıyız” denildi.

Open AI’ın CEO’su Sam Altman, Kongre’de tabir verip, ChatGPT hakkındaki soruları yanıtladı.

Open AI’ın CEO’su ve ChatGPT’nin yaratıcısı Sam Altman, Kongre’deki tabirinde AI’ı hükümetin denetlemesi ve kural koymasına takviye verdi.

Altman Senato’daki tabirinde AI “giderek güçlendiği için, sanayinin hükümet tarafından kurallara bağlanmasının değerli olduğunu” söyledi.

Yaşamın Geleceği Enstitüsü’nde kamu siyaseti araştırmacısı Carlos Ignacio Gutierrez, BBC’y yaptığı açıklamada, AI’nin ortaya çıkarttığı en büyük zorluğun, nasıl kurallar konulacağına karar verecek, örneğin Hükümetlerarası İklim Değişikliği Paneli (IPCC) üzere bir uzmanlar kurumu bulunmaması olduğunu” söyledi.

Bu da bizi, AI’nin üçüncü ve son etabına getiriyor.

3. Harika Yapay zekâ (ASI)

Teoriye nazaran ikinci basamağa (AGI) ulaştığımızda, son kademeye “Süper Yapay zekâ’ya” (ASI) atlayacağız. Bu da yapay zekânın insan zekâsından daha büyük olmasıyla gelecek.

Oxford Üniversitesi’nden filozof ve AI uzmanı Nick Bostrom, harika zekâyı “aralarında bilimsel yaratıcılık, genel bilgelik ve toplumsal kabiliyetler de dahil neredeyse her alanda insan beynini büyük ölçüde geride bırakan” bir zekâ olarak tanımlıyor.

Gutierrez de “İnsanlar mühendis, hemşire ya da avukat olmak için uzun müddet eğitim almak zorunda. AGI’nın sorunu, bizim yapamadığımız devirlerde bile daima kendini geliştirmesi” diye açıklıyor bu durumu.

Bilim Kurgu

Arnold Schwarzenegger, insanların yapay zekâyla gayret ettiği Terminatör üzere sinemalarda oyamıştı.

Princeton Üniversitesi’nden Bilgisayar Mühendisi Arvind Narayanan, daha evvel BBC’ye yaptığı açıklamada, bilim kurguya misal felaket senaryolarının gerekçi olmadığını söylemişti:

“Şu andaki AI, bu risklerin gerçeğe dönüşmesini sağlayacak kabiliyetlerin çok uzağında. Sonuç olarak bu durum, AI’nin yakın vadeli zararlarından dikkatleri uzaklaştırdı.”

2004 imali ‘Ben, Robot’ sinemasında Will Smith teknofobik bir cinayet dedektifini canlandırmıştı.

Makinelerin, bilhassa husus duygusal zekâya geldiğinde nitekim bir insanınki kadar geniş zekâya sahip olup olamayacağı konusunda birçok tartışma yapıldı. AGI’yi başarmaya yakın olduğumza inananları en çok kaygılandıran şeylerden biri de bu.

Hollywood ve AI: 1968 üretimi ‘2001: Bir Uzay Macerası” sinemasında, uzay gemisi bilgisayarı HAL, uzay gemisinin sistemlerini denetim ediyor ve mürettebata işkince yapıyordu.

Geçtiğimiz günlerde, makinelere tecrübelerinden öğrenmeyi öğretme konusundaki öncülerden “yapay zekânın babası” lakaplı Geoffrey Hinton, bir dönüm noktasına ulaşmak üzere olduğumuz uyarısı yaptı.

‘AI’nin babası’ Geoffrey Hinton, Google’den istifa ederken tehlike uyarısı yaptı.

Google’den yeni emekli olan 75 yaşındaki Hinton “Şu anda, makineler gördüğüm kadarıyla bizden daha zeki değil lakin yakında olabilirler” dedi.

Google’den ayrıldığını duyuran mektubunu New York Times gazetesine gönderen Hinton, yaptığı işten pişman olduğunu, zira “kötü aktörleri AI’yi berbat şeyler için kullanmasından korktuğunu” söyledi.

Hinton BBC’ye şu “kabus senaryosu” örneğini verdi

“Düşünün, örneğin Rusya önderi Vladimir Putin üzere berbat bir aktör, robotlara kendi al emellerini yaratabilme kabiliyeti verdi. Makineler nihayetinde ‘Daha fazla güç lazım’ üzere bir alt hedef yaratabilirler ve bu ‘varoluşsal bir tehdide’ dönüşür.”

Ancak Hinton, “daha kısa vadede” AI’nin ziyandan çok fayda sağlayacağını belirtti ve “Dolayısıyla bunları geliştirmeyi durdurmamız gerektiğini düşünmüyorum” diye de ekledi.

Yok oluş ya da ölümsüzlük

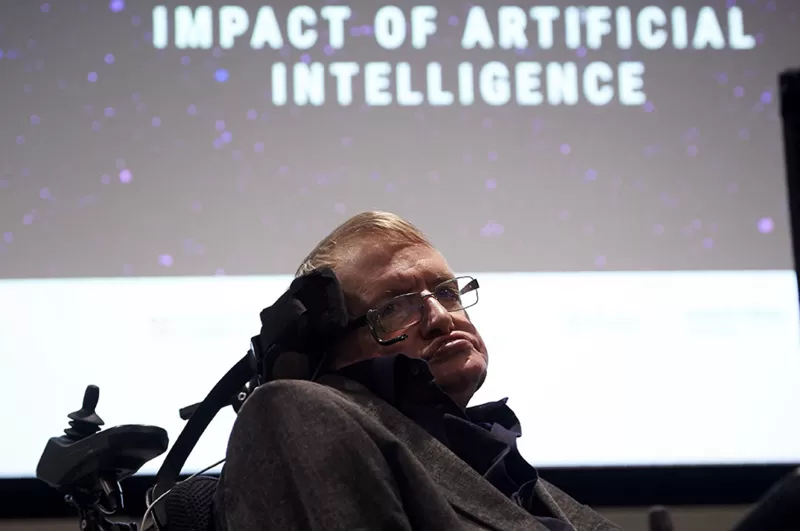

İngiliz fizikçi Stephen Hawking açık bir ihtar yapmıştı.

İngiliz fizikçi Stephen Hawking “süper akıllı AI’nin insan cinsinin sonunu beraberinde getirebileceğini” söylemişti.

Ölümünden dört yıl evvel, 2014’te BBC’ye konuşan Hawking “Tam yapay zekâ gelişimi, insan ırkının sonu manasına gelebilir” demişti.

Hawking, bu derecede zekâya sahip bir makinenin giderek arkadan bir oranda kendi başına çalışacağını ve kendisini yine tasarlayacağını belirtti.

Nanobotlar ve ölümsüzlük

AI’nin en büyük tutkunlarından biri Google’den AI araştırmacısı ve Silikon Vadisi’ndeki Singularity Üniversitesi’nin kurucularından mucit ve müellif Ray Kurzweil.

Kurzweil, insanların üstün akıllı AI’yi biyolojik mahzurları geçmek için kullanacağına inanıyor.

Kurzweil, 2015’te insanların bedenlerimizin içinde çalışan ve bütün haslıkları ya da hasarları tedavi eden nanobotlar (çok küçük robotlar) sayesinde, 2030 itibariyle ölümsüzlğü yakalayacağımızı iddia etmişti.

AI yönetimi

Guitérrez de en kıymetlisinin bir AI idare sistemi kurmak olduğunda hemfikir.

“Gezekendeki herkesle ilgili bu kadar çok bilgiye sahip ve alışkanlıklarını bilen (internet aramaları sayesinde) bir varlığın, fark etmediğimiz formlarda bizi denetim edebildiği bir gelecek düşünün” diyor.

“En berbat senaryo insan robot savaşı olmaz. En berbatı manipüle edildiğimizin farkına varmamak olur, zira gezegeni bikzden daha akıllı bir varlıkla paylaşıyoruz.”

Katkıda bulunanlar Andrew Webb ve and Chris Vallance

Bir önceki yazımız olan Japonya imkansızı başarmak üzere: Uzaydan dünyaya güç gönderecek! başlıklı makalemizde Enerji, Güneş ve Japonya hakkında bilgiler verilmektedir.